An improved tiny YOLO v3 rapid recognition model for coal-gangue

-

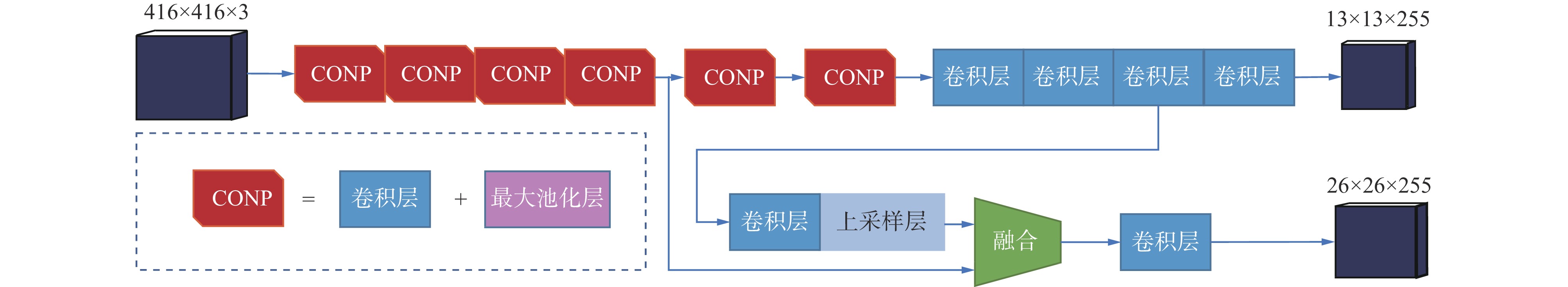

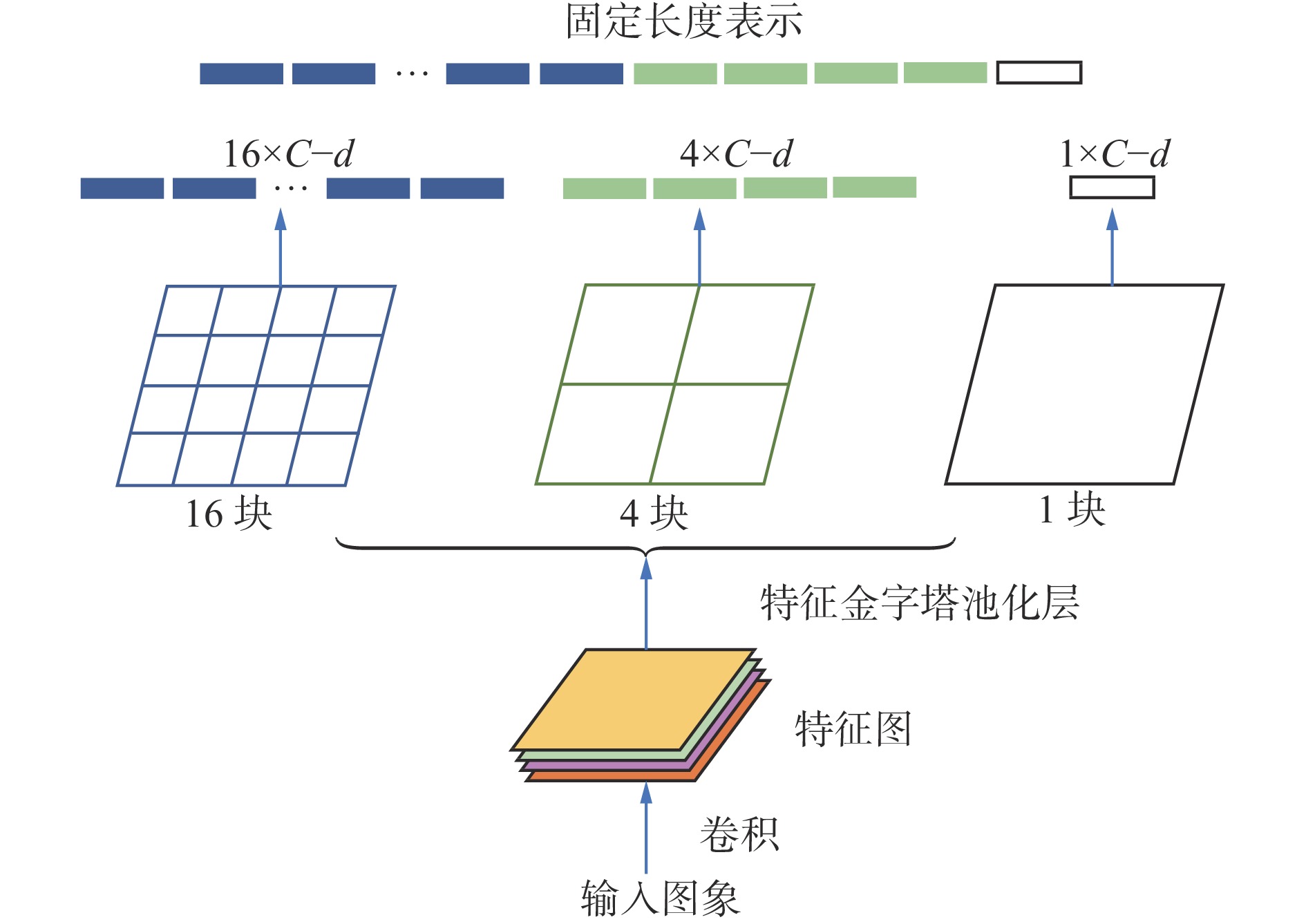

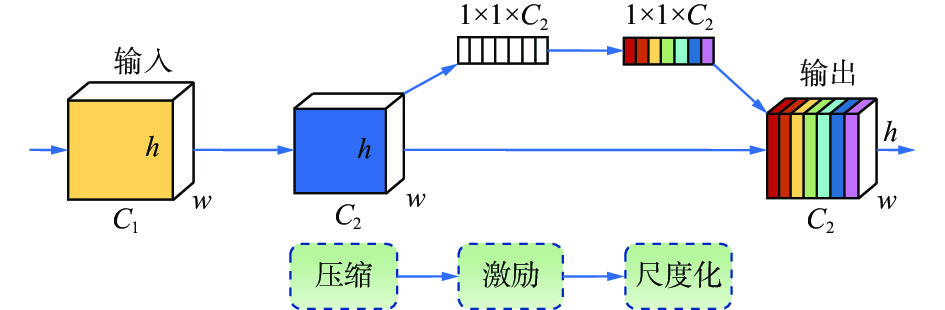

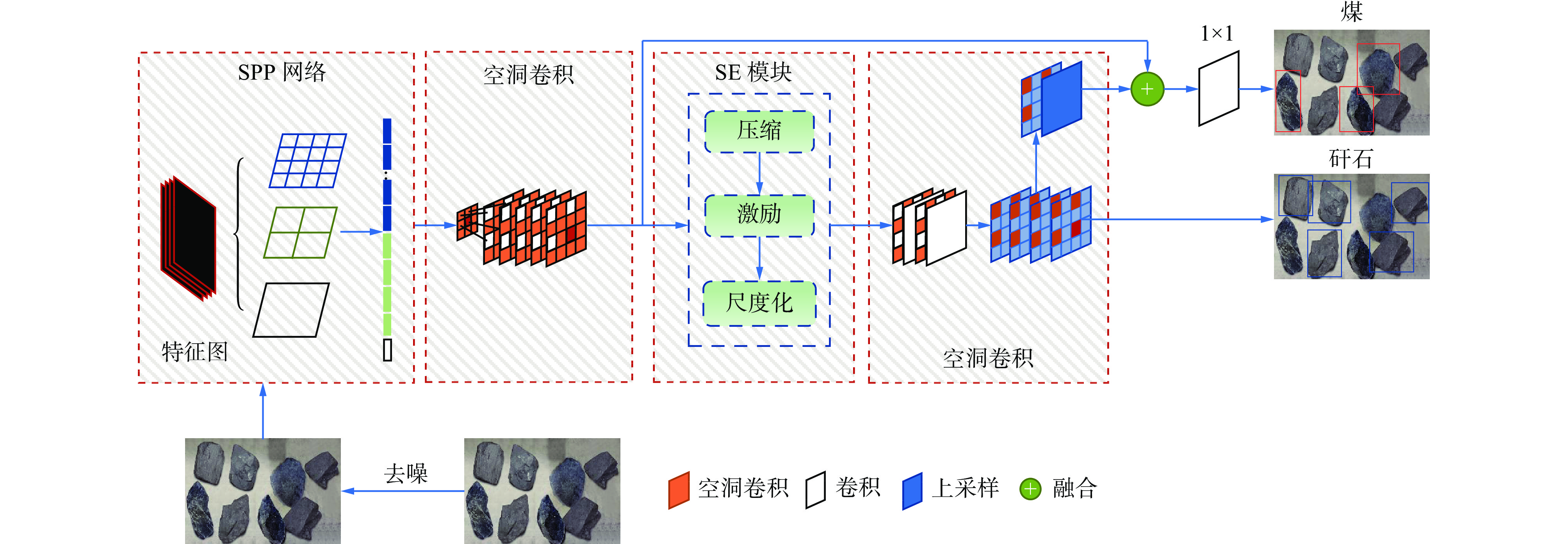

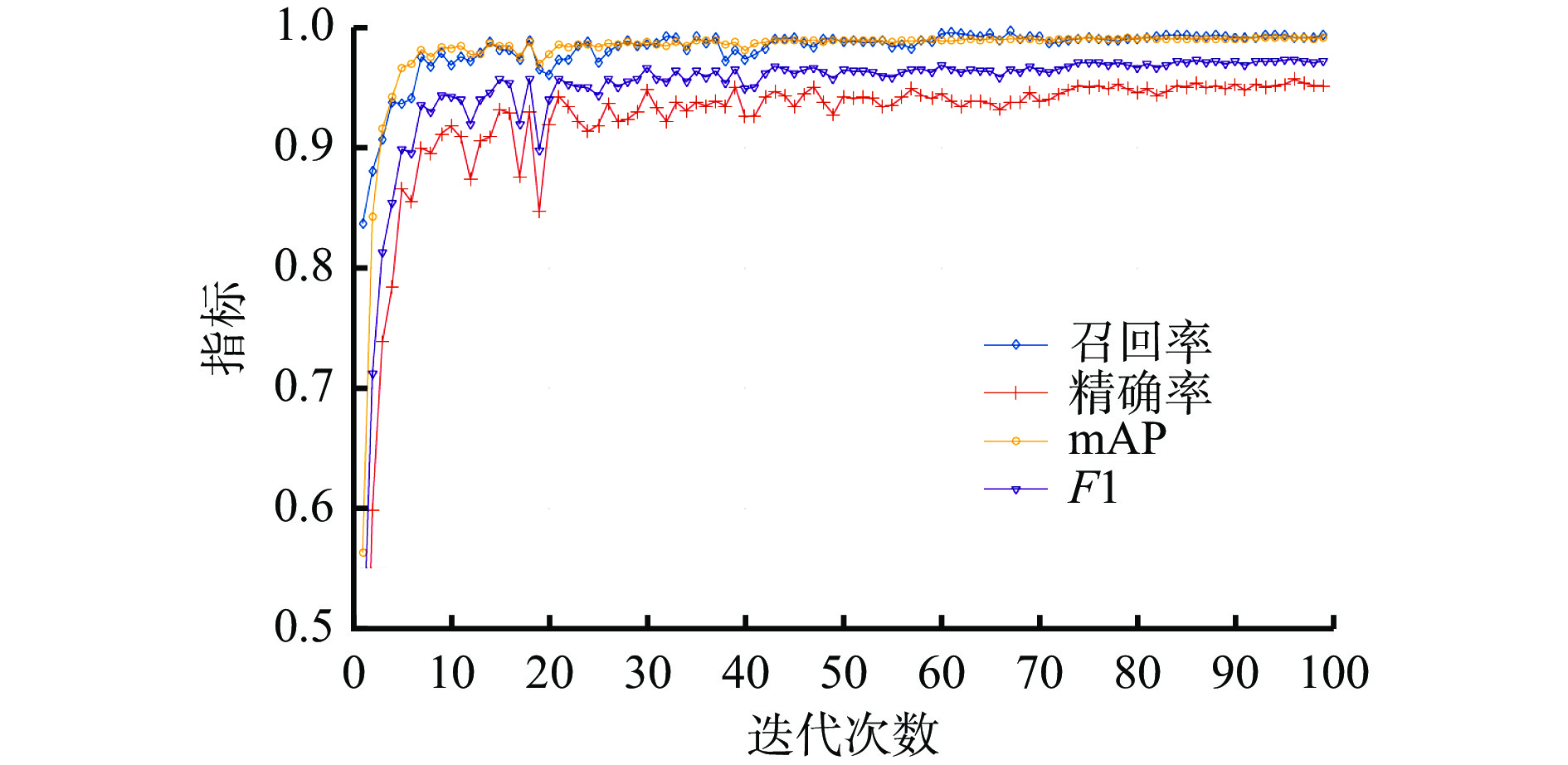

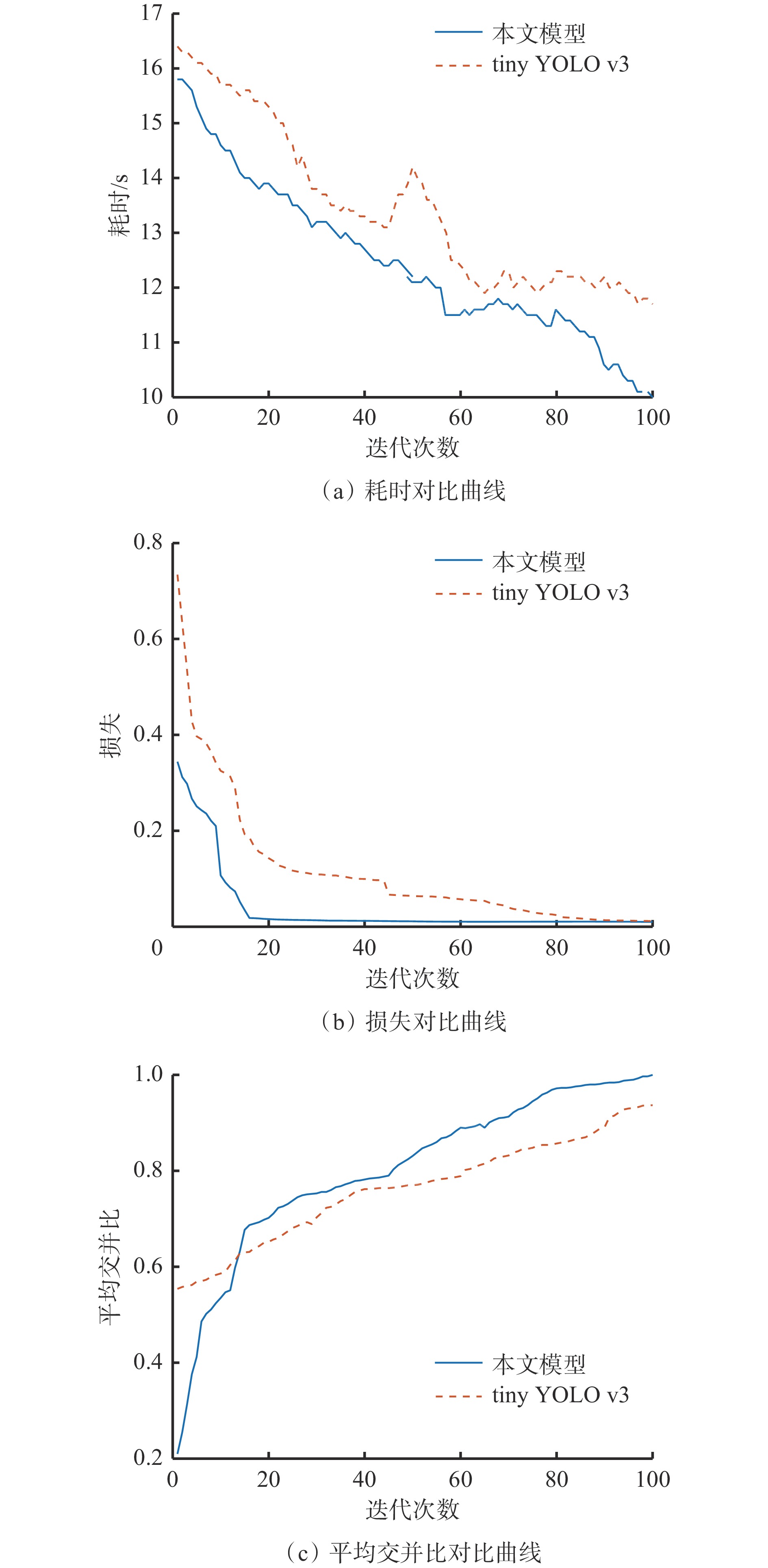

摘要: 传统的煤矸石分选方法效率低下、安全隐患较大、应用范围受限,现有的基于机器视觉的煤矸石图像识别方法在模型识别速度与精度上难以平衡,未综合考虑输入图像尺寸不一、重要通道权重较低及卷积参数量大对模型精度的影响。针对上述问题,在tiny YOLO v3模型的基础上,提出了一种改进的tiny YOLO v3煤矸石快速识别模型。首先,在tiny YOLO v3模型引入多卷积核组合池化的特征金字塔池化(SPP)网络,确保输入特征图可被处理为固定尺寸再输出;其次,引入RGB通道权重可调节的压缩激励(SE)模块,用于增强前几层特征图各通道之间的联系,强调感兴趣通道的特征值和不同目标特征之间的差异性,确保关键信息的捕捉和网络灵敏度;最后,引入包含0权值点的空洞卷积替代tiny YOLO v3模型中部分卷积层,在不增加模型参数的前提下,可捕获多尺度上下文信息进而扩大感受野,提高模型计算速度。将该模型分别与tiny YOLO v3模型、Faster RCNN模型、YOLO v5系列模型进行对比,结果表明:① 与tiny YOLO v3相比,改进的tiny YOLO v3煤矸石快速识别模型的识别准确性和快速性都有显著提升。② 与Faster RCNN相比,改进的tiny YOLO v3煤矸石快速识别模型训练时间减少了65.72%,识别精度增幅为11.83%,识别召回率增幅为0.5%,模型平均精度均值(mAP)增幅为3.02%。③ 与YOLO系列模型相比,改进的tiny YOLO v3煤矸石快速识别模型在保持识别精度优势的情况下识别速度有大幅增长。消融实验结果表明:改进的tiny YOLO v3煤矸石快速识别模型的识别准确率为99.4%,较加入SPP网络的tiny YOLO v3模型的识别准确率提高了4.9%;测试每张图片耗时12.5 ms,较加入SPP网络的tiny YOLO v3模型耗时减少了1 ms。Abstract: The traditional coal gangue sorting methods have low efficiency, significant safety hazards, and limited application scope. The existing machine vision-based coal gangue image recognition methods are difficult to balance model recognition speed and accuracy. And the methods do not comprehensively consider the impact of different input image sizes, low important channel weights, and large convolution parameters on model precision. In order to solve the above problems, an improved tiny YOLO v3 coal gangue rapid recognition model is proposed based on the tiny YOLO v3 model. Firstly, a spatial pyramid pooling (SPP) network with multiple convolutional kernels combined pooling is introduced in the tiny YOLO v3 model to ensure that the input feature maps can be processed to a fixed size before being output. Secondly, a squeeze-and-excitation (SE) module with adjustable RGB channel weights is introduced to enhance the connections between the channels in the previous layer feature maps. It emphasizes the differences between the feature values of the interested channels and the features of different targets. It ensures the capture of key information and network sensitivity. Finally, the dilated convolution containing zero weight points is introduced to replace part of the convolution layer in the tiny YOLO v3 model. Under the premise of not adding model parameters, multi-scale context information can be captured to expand the receptive field and improve the calculation speed of the model. This model is compared with the tiny YOLO v3 model, Faster RCNN model, and YOLO v5 series models respectively. The results show the following points. ① Compared with tiny YOLO v3, the improved tiny YOLO v3 coal gangue rapid recognition model has significantly improved recognition accuracy and speed. ② Compared with Faster RCNN, the improved tiny YOLO v3 coal gangue rapid recognition model has reduced training time by 65.72%, increased recognition precision by 11.83%, increased recognition recall by 0.5%, and increased model mean average precision (mAP) by 3.02%. ③ Compared with the YOLO series model, the improved tiny YOLO v3 coal gangue rapid recognition model has a significant increase in recognition speed while maintaining the advantage of recognition precision. The results of the ablation experiment show that the improved tiny YOLO v3 coal gangue rapid recognition model has a recognition accuracy of 99.4%. It is 4.9% higher than the tiny YOLO v3 model added with the SPP network. The time to test each image is 12.5 ms, which is 1 ms less than the tiny YOLO v3 model added to the SPP network.

-

0. 引言

煤炭是我国的主体能源,煤矿智能化建设是我国煤炭工业高质量发展的方向[1-3]。综采工作面的刮板输送机在运输煤流的过程中,大块煤易造成煤流堵塞,引发堆煤现象,严重影响机械设备性能和采煤效率[4-7]。由于综采工作面低照度、运动模糊和粉尘、水雾等特殊环境条件[8],且受限于煤矿井下的低算力设备,现有的目标检测算法往往存在精度低、模型占用的内存大、硬件依赖强等问题。因此,设计精度高、轻量化、移动端易部署的大块煤目标检测算法对于综采工作面安全生产有重要意义。

综采工作面环境恶劣,存在运动模糊、尺度变化、遮挡等复杂工况。传统的目标检测算法存在效率低、准确率较低等问题[9]。随着计算机视觉技术的发展,基于深度学习的目标检测技术[10]被应用到煤矿井下目标检测中。曹现刚等[11]提出了一种跨模态注意力融合的煤炭异物检测方法,有效提高了复杂特征异物检测精度,减少了误检、漏检现象。高涵等[12]融合特征增强与Transformer的方法,实现了煤矿输送带异物检测,有效解决了输送带异物目标检测中细长物体检测效果差、弱语义特征提取困难的问题。张立亚[13]提出了一种基于生成对抗网络的带式输送机异物检测方法,采用深度可分离卷积代替原有主干网络中的卷积操作,大幅降低了模型计算量,提高了异物检测速度。王科平等[14]以YOLOv4模型为基础,通过深度可分离卷积替换传统卷积,在主干网络中添加残差自注意力模块,减少了模型参数量和计算量,实现了检测模型的工业部署。李江涛等[15]提出了一种基于异物识别模型的轻量化策略,减小了模型大小和运行时占用的内存。

上述研究通过添加注意力机制、更换深度可分离卷积等操作,一定程度上提升了煤矿目标检测精度,但仍存在以下问题:模型占用的内存过大,导致部署困难;轻量化设计虽提升了模型的检测速度,但导致精度下降。针对上述问题,本文以YOLOv5s为基础,通过轻量化MobileNetV3网络、高效多尺度注意力(Efficient Multi-Scale Attention,EMA)模块、SIoU损失函数对模型进行改进,提出了一种基于MES−YOLOv5s的综采工作面大块煤检测算法,并通过实验验证了该算法的有效性。

1. 基础模型选择

YOLO网络因其在速度和准确性方面的显著平衡而在目标检测模型中脱颖而出。YOLO系列中常用的网络有YOLOv5,YOLOv7,YOLOv8。YOLO系列网络性能对比如图1所示,n,s,m,l,x表示YOLO的不同变体,E为3种模型在COCO数据集上的检测精度(阈值范围为0.50~0.95),m为模型占用的内存,t为CPU检测时间。可看出,YOLOv8网络模型整体性能优于其他网络模型,但检测速度较慢;YOLOv7网络模型精度较高,但检测速度慢,且模型占用的内存大,难以部署;YOLOv5网络模型精度较低,但具有参数量少、易训练、推理速度快和部署简单等特点;YOLOv5s性能优于YOLOv8n,且检测时间和占用的内存与YOLOv8n差距较小。综合性能和实际工况考虑,本文选择YOLOv5s作为基础模型。

YOLOv5s网络模型[16]主要包括输入层、主干网络、颈部网络、检测头4个部分。输入层包含数据增强方法,对随机4张图像进行任意缩放和拼接,以扩张数据集并提高训练效率。主干网络是由卷积(Conv)模块、C3模块和快速空间金字塔池化(Spatial Pyramid Pooling-Fast,SPPF)模块组成。Conv模块用于提取物体特征,C3模块对特征信息进行残差连接,SPPF模块融合不同尺度的特征信息。颈部网络由特征金字塔网络(Feature Pyramid Network,FPN)和路径聚合网络(Path Aggregation Network,PAN)[17]组成,用于提高多尺度检测精度。检测头输出预测结果,生成预测类别。

2. MES−YOLOv5s网络模型

在煤矿井下,煤机装备等移动端设备搭载的硬件算力低,而目标检测任务实时性要求高。针对该问题,本文设计了MES−YOLOV5s网络模型,其结构如图2所示。

2.1 主干网络改进

YOLOv5s的主干网络由卷积模块和C3模块堆叠组成,该结构能够较好地提取物体特征信息,但参数量大、计算量大、推理时间长,难以部署到移动端等算力较低的设备上。因此,本文使用MobileNetV3替代主干网络。

MobileNetV3的核心模块是bneck,该模块主要包含可分离卷积、压缩和激励(Squeeze-and-Excitation, SE)通道注意力机制和shortcut连接,如图3所示[17-18]。特征图首先经过1×1卷积升维,再通过3×3深度可分离卷积,保持通道数不变。SE通道注意力机制为每一个通道赋予权重。设输入特征图维度为C×H×W(通道数×高×宽),经过全局平均池化得到C×1×1的张量,该张量包含每个通道的权重。将通道权重与对应通道的输入特征相乘,再通过1×1卷积降维,得到深层信息。最后通过shortcut将浅层特征信息传递到深层,实现特征复用。

2.2 EMA模块

由于大块煤检测任务目标遮挡严重,密集分布且MobileNetV3网络缩减了大量模型参数,导致YOLOv5s模型精度下降。因此,本文在颈部网络引入EMA模块[19],保留各通道信息并进一步减少计算开销。

EMA模块结构如图4所示[19]。在空间维度上,对于输入维度为C×H×W的特征图,按通道将其分为G组,每组的维度为(C/G)×H×W。通过一维水平全局池化X Avg Pool、一维垂直全局池化Y Avg Pool、3×3卷积3个并行分支进行处理。前2个分支输出的特征经过Sigmoid激活函数激活,最后通过Concat将2个通道注意力特征聚合。3×3卷积操作用于提取特征图的特征。跨空间学习方法利用二维全局平均池化将全局空间信息编码并通过1×1分支输出,建立信息短期和长期依赖关系。最后输出维度为C×H×W的特征图。

2.3 SIoU损失函数

YOLOv5s模型的损失函数为CIoU[20],该函数依赖于预测框与真实框的距离、重叠区域和纵横比,未考虑到预测框与真实框的方向匹配问题,在模型训练过程中,预测框的方向会产生振荡。因此,本文采用SIoU[21]损失函数,该函数考虑到所需回归之间的向量角度,重新定义了惩罚指标,提高了训练速度和推理准确性。

SIoU损失函数中添加了角度损失,当预测框与真实框水平方向夹角$ \alpha \leqslant \text{π}/4 $时,收敛过程首先最小化$ \alpha $;当预测框与真实框垂直方向夹角$ \beta \leqslant \text{π}/4 $时,收敛过程首先最小化$ \beta $。

$$ \beta = \frac{{\text{π}}}{2} - \alpha $$ (1) $$ \sigma=\sqrt{\left(b_{x}^{{\mathrm{g t}}}-b_{x}\right)^{2}+\left(b_{y}^{{\mathrm{g t}}}-b_{y}\right)^{2}} $$ (2) $$ D_{y}=\max \left(b_{y}^{{\mathrm{gt}}}, b_{y}\right)-\min \left(b_{y}^{{\mathrm{gt}}}-b_{y}\right) $$ (3) $$ \mathit{\mathit{\mathrm{\mathit{F}}}}=1-2\sin^2\left(\arcsin\left(\frac{D_y}{\sigma}\right)-\frac{\text{π}}{4}\right) $$ (4) 式中:$ \sigma $为预测框与真实框中心点的欧氏距离;$ {b}_{x}^{{\mathrm{gt}}} $,$ {b}_{y}^{{\mathrm{gt}}} $为真实框的中心点坐标;$ {b}_{x} $,$ {b}_{y} $为预测框的中心点坐标;$ {D}_{y} $为预测框与真实框中心点垂直方向距离;F为角度损失和距离损失的综合表示。

3. 实验及结果分析

3.1 数据采集及预处理

实验使用文献[22]提供的长壁综采工作面数据集,将大块煤数据集按照8∶1∶1的比例划分,共包含16 813张训练图像、2 101张验证图像、2 101张测试图像。长壁综采工作面数据集处理流程如图5所示,包含数据采集、数据过滤和数据标注。首先将采集到井下原始监控视频数据通过FFmpeg软件切成帧图像,通过数据过滤操作筛出不完整、难识别、运动模糊、远距离的图像,最后使用LabelImg软件完成数据标注。

3.2 实验配置及评价指标

硬件配置:操作系统为ubuntu20.04,cuda版本为11.3,CPU型号为Intel(R) Xeon(R) Platinum 8369B CPU @2.90 GHz,GPU型号为NVIDIA A10。

软件及训练参数:输入图像分辨率为1 920×1 080,迭代次数为300,初始学习率为0.01,batch-size为32,选用SGD优化器,学习率动量为0.937;python版本为3.9,pytorch框架版本为1.12,OpenCV版本为4.5.1。

使用召回率、平均精度均值(mean Average Precision,mAP)作为模型的评价指标。

$$ P=\frac{{\mathrm{T P}}}{{\mathrm{T P}}+{\mathrm{F P}}} $$ (5) $$ R=\frac{{\mathrm{T P}}}{{\mathrm{T P}}+{\mathrm{F N}}} $$ (6) $$ {\mathrm{A P}}=\sum_{k=0}^{n-1}[R(k+1)-R(k)] P(k) $$ (7) $$ {\mathrm{m A P}}=\frac{1}{L} \sum_{i=1}^{L} {\mathrm{A P}}_{i} $$ (8) 式中:P为精确度;TP为预测类别与真实类别都为真的目标数目;FP为预测类别为真、真实类别为假的目标数目;R为召回率;FN为预测类别为假、真实类别为真的目标数目;AP为平均精确度;n为检测框数目;L为类别数,当L = 1时,mAP与AP相等。

3.3 消融实验

为验证各模块的效果,以相同的实验配置进行消融实验,结果见表1。可看出采用MobileNetV3替代主干网络后,模型的mAP降低了4.2%,内存减少了43 MiB,检测时间减少了39.7 ms;在颈部网络添加EMA模块后,模型的mAP增加了2.2%,内存增加了0.6 MiB,检测时间增加了7.2 ms;在检测头部使用更为高效的SIoU损失函数后,模型的mAP增加了0.6%,内存保持不变,检测时间减少了3.6 ms;同时添加3项改进策略后,模型的mAP达84.6%,占用内存为11.2 MiB,检测时间为31.8 ms。

表 1 消融实验结果Table 1. Ablation test results改进策略 mAP/% 占用内

存/MiBCPU检测

时间/msMobileNetV3 EMA SIoU × × × 85.1 54.1 68.5 √ × × 80.9 11.1 28.8 × √ × 87.3 54.7 75.7 × × √ 85.7 54.1 64.9 √ √ √ 84.6 11.2 31.8 消融实验结果表明:MobileNetV3大幅减少了模型占用的内存和检测时间,但mAP损失严重;EMA模块和SIoU损失函数可在一定程度上恢复损失的精度,同时保证模型在CPU上具有较高的检测速度,满足煤矿井下目标实时检测需求。

3.4 对比实验

为进一步验证MES−YOLOv5s的性能,在CPU测试环境下,将其与DETR[22],YOLOv5n,YOLOv5s,YOLOv7进行对比。DETR是基于Transformer的目标检测框架,使用 Transformer 编码器−解码器架构来同时预测所有对象,比传统的目标检测器更简单、更高效。实验结果见表2。可看出MES−YOLOv5s模型的mAP达84.6%,较DETR,YOLOv5n分别增加了3.3%,0.7%,较YOLOv5s,YOLOv7模型分别减少了0.5%,1.9%;模型占用的内存为11.2 MiB,较DETR,YOLOv5n,YOLOv5s,YOLOv7模型分别减少了137.8,2.8,42.9,273.4 MiB;检测时间为31.8 ms,较DETR,YOLOv5n,YOLOv5s,YOLOv7模型分别减少了464.4,0.1,36.7,289.0 ms。

表 2 对比实验结果Table 2. Comparative experimental results模型 mAP/% 占用内存/MiB CPU检测时间/ms DETR 81.3 149 496.2 YOLOv5n 83.9 14 31.9 YOLOv5s 85.1 54.1 68.5 YOLOv7 86.5 284.6 320.8 MES−YOLOv5s 84.6 11.2 31.8 对比实验结果表明,MES−YOLOv5s模型的精度较高,内存小,CPU检测速度快,综合性能优于其他模型,更适合部署于低算力设备。

在测试集上采用各模型进行实验,部分结果如图6所示。第1组实验在高速运动、多尺度的工况下进行,DETR,YOLOv5n,MES−YOLOv5s模型对于小尺度目标的mAP小于50%,YOLOv5s,YOLOv7模型的mAP大于50%。第2组实验在遮挡、多目标的工况下进行,DETR和YOLOv5n模型出现误检情况,YOLOv5s,YOLOv7, MES−YOLOv5s模型的召回率为100%,且mAP大于85%。第3组实验在静止的工况下进行,DETR模型的精确度为57%,其他模型的召回率为100%,mAP大于85%。第4组实验在高速运动、多尺度、遮挡的工况下进行,DETR模型的精确度为85%,其他模型的召回率为100%,YOLOv7和MES−YOLOv5s模型的mAP大于60%。

MES−YOLOv5s模型综合性能表现最好,在高速运动、多尺度、遮挡和多目标的工况环境下能够保持较高的召回率和精度。

4. 结论

1) 采用MobileNetV3网络替换YOLOv5s的主干网络,以适应模型在移动端的部署,模型占用的内存减少了43 MiB,CPU端检测时间减少了39.7 ms。在颈部网络添加EMA模块,以保留各通道信息并进一步减少计算开销,mAP增加了2.2%,模型占用的内存增加了0.6 MiB,检测时间增加了7.2 ms。在检测头部更换SIoU损失函数,以提高模型的训练速度和推理的准确性,mAP增加了0.6%,模型占用的内存保持不变,检测时间增加了3.6 ms。

2) 与DETR,YOLOv5n,YOLOv5s,YOLOv7模型进行对比,MES−YOLOv5s模型综合性能最好,mAP为84.6%,模型占用的内存为11.2 MiB,在CPU端的检测时间为31.8 ms,在高速运动、多尺度、遮挡和多目标的工况环境下能够保持较高的召回率和精度。

-

表 1 本文模型和Faster RCNN识别数据对比

Table 1 Comparison of identification data between the proposed model and Faster RCNN

% 模型 类别 精确率 召回率 F1 mAP 本文模型 煤 95.3 95.5 97.4 99.4 矸石 97.2 99.9 98.6 Faster RCNN 煤 89.9 94.1 92.0 96.4 矸石 85.7 99.4 92.0 提升 煤 5.67 5.43 5.54 3.02 矸石 11.83 0.5 6.69 表 2 本文模型与YOLOv5系列识别数据对比

Table 2 Comparison between the proposed model and the identification data of YOLOv5 series

模型 识别速度/(帧·s-1) mAP/% YOLO v5s 42.7 96.1 改进YOLO v5s 45.1 98.3 CBA−YOLO 46.7 99.1 本文模型 80 99.4 表 3 各模块消融实验数据对比

Table 3 Comparison of ablation data of each module

改进策略 准确率/% 每张图片耗时/ms SE模块 空洞卷积 × × 94.5 13.5 √ × 97.3 14.1 × √ 96.7 10.9 √ √ 99.4 12.5 -

[1] 曹现刚,李莹,王鹏,等. 煤矸石识别方法研究现状与展望[J]. 工矿自动化,2020,46(1):38-43. CAO Xiangang,LI Ying,WANG Peng,et al. Research status of coal-gangue identification method and its prospect[J]. Industry and Mine Automation,2020,46(1):38-43.

[2] 张新. 基于LoRa技术的煤矿作业环境实时监测系统设计[J]. 自动化仪表,2019,40(3):69-73. DOI: 10.16086/j.cnki.issn1000-0380.2018080051 ZHANG Xin. Design of real-time monitoring system based on LoRa technology for coal mine operation environment[J]. Process Automation Instrumentation,2019,40(3):69-73. DOI: 10.16086/j.cnki.issn1000-0380.2018080051

[3] 郭秀军. 煤矸石分选技术研究与应用[J]. 煤炭工程,2017,49(1):74-76. DOI: 10.11799/ce201701022 GUO Xiujun. Research and application of coal gangue separation technology[J]. Coal Engineering,2017,49(1):74-76. DOI: 10.11799/ce201701022

[4] MOHANTA K S,MEIKAPB C. Influence of medium particle size on the separation performance of an air dense medium fluidized bed separator for coal cleaning[J]. Journal of the Southern African Institute of Mining and Metallurgy,2015,115(8):761-766.

[5] 陈岩. 基于多元化应用的煤矸石高效破碎分选技术研究[D]. 武汉: 武汉理工大学, 2015. CHEN Yan. Research on efficient crushing and separating technology of coal gangue based on diversified application[D]. Wuhan: Wuhan University of Technology, 2015.

[6] 高新宇. 基于机器视觉的煤矸智能分选系统设计[D]. 太原: 太原理工大学, 2021. GAO Xinyu. Design of intelligent separation system for coal and gangue based on machine vision[D]. Taiyuan: Taiyuan University of Technology, 2021.

[7] 王征,潘红光. 基于改进差分进化粒子群的煤尘颗粒图像辨识[J]. 煤炭学报,2020,45(2):695-702. DOI: 10.13225/j.cnki.jccs.2019.0074 WANG Zheng,PAN Hongguang. Recognition of coal dust image based on improved differential evolution particle swarm optimization[J]. Journal of China Coal Society,2020,45(2):695-702. DOI: 10.13225/j.cnki.jccs.2019.0074

[8] 沈科,季亮,张袁浩,等. 基于改进YOLOv5s模型的煤矸目标检测[J]. 工矿自动化,2021,47(11):107-111,118. SHEN Ke,JI Liang,ZHANG Yuanhao,et al. Reserch on coal and gangue detection algorithm based on improved YOLOv5s model[J]. Industry and Mine Automation,2021,47(11):107-111,118.

[9] 桂方俊,李尧. 基于CBA−YOLO模型的煤矸石检测[J]. 工矿自动化,2022,48(6):128-133. DOI: 10.13272/j.issn.1671-251x.2022020033 GUI Fangjun,LI Yao. Coal gangue detection based on CBA-YOLO model[J]. Journal of Mine Automation,2022,48(6):128-133. DOI: 10.13272/j.issn.1671-251x.2022020033

[10] LI Dongjun,ZHANG Zhenxin,XU Zhihua,et al. An image-based hierarchical deep learning framework for coal and gangue detection[J]. IEEE Access,2019,7:184686-184699. DOI: 10.1109/ACCESS.2019.2961075

[11] 陈彪,卢兆林,代伟,等. 基于轻量化HPG−YOLOX−S模型的煤矸石图像精准识别[J]. 工矿自动化,2022,48(11):33-38. CHEN Biao,LU Zhaolin,DAI Wei,et al. Accurate image recognition of coal gangue based on Lightweight HPG-YOLOX-S model[J]. Journal of Mine Automation,2022,48(11):33-38.

[12] PU Yuanyuan,APEL D B,SZMIGIEL A,et al. Image recognition of coal and coal gangue using a convolutional neural network and transfer learning[J]. Energies,2019,12(9):1735-1742. DOI: 10.3390/en12091735

[13] 马致颖. 基于CNN−ELM混合模型的煤矸石图像识别方法研究[D]. 淮南: 安徽理工大学, 2022. MA Zhiying. Research on coal gangue image recognition method based on CNN-ELM hybrid model[D]. Huainan: Anhui University of Science and Technology, 2022.

[14] REDMON J, FARHADI A. YOLOv3: an incremental improvement[EB/OL]. [2023-01-08]. https://arxiv.org/pdf/1804.02767.pdf.

[15] BOCHKOVSKIY A, WANG C Y, LIAO H. YOLOv4: optimal speed and accuracy of object detection[EB/OL]. [2023-01-08]. https://arxiv.org/pdf/2004.10934.pdf.

[16] LI Longlong,WANG Zhifeng,ZHANG Tingting. GBH-YOLOv5:ghost convolution with bottleneckCSP and tiny target prediction head incorporating YOLOv5 for PV panel defect detection[J]. Electronics,2023,12(3):561-576. DOI: 10.3390/electronics12030561

[17] YU F, KOLTUN V. Multi-scale context aggregation by dilated convolutions[C]. International Conference on Learning Representations, Puerto Rico, 2016: 1-13.

[18] REDMON J, DIVVALA S, GIRSHICK R, et al. You only look once: unified, real-time object detection[C]. IEEE Conference on Computer Vision and Pattern Recognition (CVPR), Las Vegas, 2016: 779-788.

[19] REDMON J, FARHADI A. YOLO9000: better, faster, stronger[C]. 2017 IEEE Conference on Computer Vision and Pattern Recognition (CVPR), Honolulu, 2017: 7263-7271.

[20] LI Chuyi, LI Lulu, JIANG Hongliang, et al. YOLOv6: a single-stage object detection framework for industrial applications[EB/OL]. [2022-09-07]. https://arxiv.org/pdf/2209.02976.pdf.

[21] 张陈晨,靳鸿. 基于改进YOLOv3−tiny的目标检测技术研究[J]. 兵器装备工程学报,2021,42(9):215-218,312. DOI: 10.11809/bqzbgcxb2021.09.034 ZHANG Chenchen,JIN Hong. Research on target detection based on improved YOLOv3-tiny[J]. Journal of Ordnance Equipment Engineering,2021,42(9):215-218,312. DOI: 10.11809/bqzbgcxb2021.09.034

-

期刊类型引用(6)

1. 王崭,于洵,陈玉娇,韩峰,刘宝元,马群,龚昌妹. 基于YOLOv5s的轻量化机载空空导弹红外抗干扰方法. 光学与光电技术. 2025(01): 35-44 .  百度学术

百度学术

2. 杨飞. 基于轻量化和注意力机制改进YOLOv5网络的模具缺陷识别. 模具技术. 2025(01): 88-96 .  百度学术

百度学术

3. 滕文想,王成,费树辉. 基于HGTC-YOLOv8n模型的煤矸识别算法研究. 工矿自动化. 2024(05): 52-59 .  本站查看

本站查看

4. 陈腾杰,李永安,张之好,林斌. 基于改进YOLOv8n+DeepSORT的带式输送机异物检测及计数方法. 工矿自动化. 2024(08): 91-98 .  本站查看

本站查看

5. 李利,梁晶,陈旭东,寇发荣,潘红光. 基于多注意融合网络的输煤皮带异物识别方法. 西安科技大学学报. 2024(05): 976-984 .  百度学术

百度学术

6. 曹正峰,杜欣月,李欣. 基于深度学习的再生骨料分类方法研究. 建筑机械化. 2024(11): 142-148 .  百度学术

百度学术

其他类型引用(1)

下载:

下载: